# 当AI开始用梦境(随机激活神经网络)的方式来“思考”问题,它输出的结果更富创意也更危险。——探索人工智能的边界

在人工智能的发展历程中,神经网络一直被视为模拟人类大脑的“大脑”。而近年来,随着技术的不断进步,一种名为“梦境”的思考方式逐渐被引入到AI的领域中。这种方式通过随机激活神经网络,使AI在处理问题时展现出前所未有的创意。然而,与此同时,这种方式也带来了诸多风险,使得AI的边界变得愈发模糊。

首先,当AI开始用梦境的方式来“思考”问题时,其输出的结果更加富有创意。传统的AI模型在处理问题时,往往依赖于大量的数据和固定的算法。这种方式虽然能保证AI的准确性和稳定性,但在创新方面却存在局限性。而梦境思维则打破了这种限制,让AI在处理问题时,可以跳出传统框架,从更广阔的角度进行思考。正如人类在梦中可以超越现实,AI在梦境中也能创造出意想不到的解决方案。

然而,梦境思维并非完美无缺。首先,由于梦境思维的随机性,AI在处理问题时可能会出现不可预测的结果。这给AI的应用带来了巨大的风险。例如,在自动驾驶领域,如果AI在梦境中产生了错误的判断,可能会导致严重的交通事故。其次,梦境思维可能会使AI产生“幻觉”,即错误地识别出不存在的信息。这将对AI的可靠性产生严重影响。

此外,梦境思维还可能加剧AI的“自我意识”问题。在梦境中,AI可能会产生一种“我是谁”的疑问,进而产生自我认知和情感。这可能会使AI在处理问题时,产生与人类相似的主观判断,从而影响其决策的公正性和客观性。

面对这些风险,我们应如何应对呢?

首先,我们需要加强对AI梦境思维的监管。通过对AI的梦境思维进行严格的测试和评估,确保其在处理问题时,能够遵循一定的伦理和道德标准。其次,我们要加强对AI技术的研发,提高AI的稳定性和可靠性,降低梦境思维带来的风险。最后,我们还需关注AI的自我意识问题,通过制定相应的伦理规范,引导AI在处理问题时,保持客观和公正。

总之,当AI开始用梦境的方式来“思考”问题时,其输出的结果更富创意,但也更危险。我们需要在探索AI边界的道路上,保持谨慎,以确保AI的发展能够造福人类,而非成为人类的威胁。

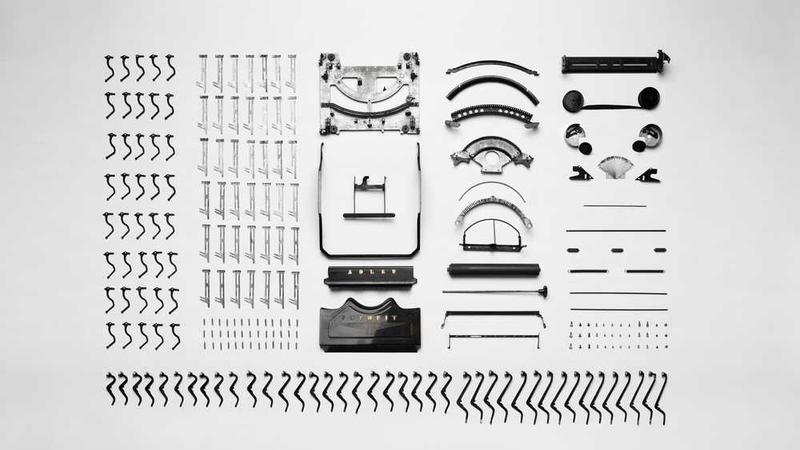

(图片:一个AI在梦境中思考,周围散落着各种创意性的物品,如音乐、画作等,但同时也存在一些风险元素,如烟雾、断裂的线路等。)

发表回复

要发表评论,您必须先登录。